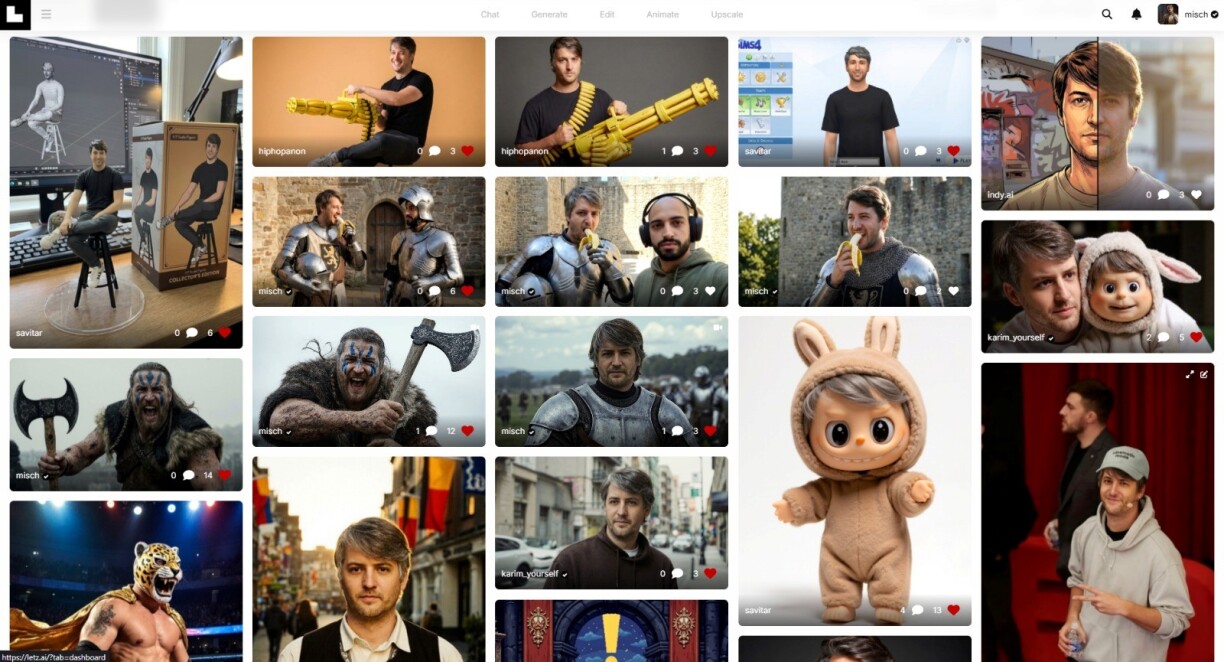

L’outil IA du réseau social X, “Grok”, ayant notamment généré sur demande des contenus pédocriminels, des enquêtes sont en cours dans le monde entier. Il est difficile de dire si les exploitants de Grok ont commis des erreurs délibérées ou s’ils ont été victimes de leur succès, estime Misch Strotz, cofondateur de LetzAI, dans une interview à RTL. La plateforme luxembourgeoise d’intelligence artificielle permettant de générer des images et des vidéos compterait, dix ans après sa création, 100.000 utilisateurs, principalement des professionnels. Peut-on faire sur LetzAI ce qui s’est produit avec Grok, à savoir dénuder des enfants ? “Non”, affirme Misch Strotz.

Mettre des gens en bikini est possible, il y aurait une certaine “censure”. Il explique que LetzAI utilise principalement l’algorithme Nano Banana de Google, très différent de celui de Grok. Il y a des filtres et il est “d’office” impossible de générer des images de mineurs. LetzAI dispose en outre de filtres supplémentaires : “nous vérifions aussi, en plus de l’image générée, ce que l’utilisateur a saisi”. Demander une image d’un mineur ne fonctionnerait pas et, après plusieurs tentatives, une alerte serait déclenchée et LetzAI pourrait décider de bloquer l’utilisateur.

“Il y a aussi des règles qui interdisent avant tout la génération de contenu criminel”, ajoute Misch Strotz. Les images générées avec des célébrités ne peuvent pas être utilisées pour des publicités sans leur consentement.

C’est également ce que prévoient les règles de l’Union européenne. Lorsqu’on utilise la photo d’une personnalité, on ne peut pas l’employer à des fins professionnelles sans son consentement. Misch Strotz souligne toutefois que ce qui semble bien en théorie n’est pas toujours évident en pratique, car le contrôle n’est pas toujours possible, selon lui.

Une autre règle dans le domaine de l’IA et des deepfakes est qu’une image générée doit toujours être clairement identifiée comme telle. Le terme technique est “watermarking”. Cela fonctionne par contre relativement bien, d'après Misch Strotz.

Alors que le patron de Grok, le multimilliardaire Elon Musk, qualifie sans cesse ces règles de censure, Misch Strotz adopte une vision plus nuancée. Pour le dirigeant de LetzAI, ce n’est pas seulement une question idéologique, mais aussi technique : “Vous savez comment ça se passe, dès qu’un outil devient un peu populaire sur Internet, vous avez soudain les personnes les plus étranges qui essaient d’exploiter l’outil à fond."

La question est de savoir comment mettre en place une censure que l’utilisateur intelligent ne puisse contourner. C’est pourquoi Misch Strotz se demande s'il y a eu réellement une “mauvaise intention” chez Grok ou X ou s’ils ont peut-être été victimes de leur propre succès.

L’intelligence artificielle ne peut pas supprimer les fantasmes des gens. Ce serait comme dire à un artiste qu’il ne doit peindre que des paysages avec son pinceau. En revanche, on peut décider de ce qu’il est autorisé à diffuser publiquement.

Selon Misch Strotz, nous entrons dans une nouvelle phase. Son message aux autorités et aux responsables politiques : ne plus faire “comme si tout se produisait du jour au lendemain” et accepter qu’il est déjà, ou sera bientôt, impossible de distinguer une image générée par IA d’une image humaine. Pour lui, tout dépendra alors de “l’intelligence humaine”.